一、Nemotron 3 Super的核心功能是什么?为什么选择它作为AI智能体大脑?

Nemotron 3 Super是英伟达在2026年3月11日正式发布的开源权重AI大模型,也是该公司迄今为止最强大的开源模型。作为Nemotron 3系列的重要成员,这款模型专门为大规模运行复杂的代理式AI系统设计,旨在解决传统多智能体工作流中的”上下文爆炸”和”思考税”两大核心难题。

Nemotron 3 Super核心功能快览

Nemotron 3 Super是一款专为大规模AI智能体系统设计的开源大语言模型。它采用创新的混合Mamba-Transformer架构和MoE专家网络,总参数1200亿,推理时仅激活120亿参数,实现高效计算。模型原生支持100万token超长上下文窗口,在PinchBench智能体测试中取得85.6%的高分。针对英伟达Blackwell平台深度优化,采用NVFP4精度训练,相比前代吞吐量提升5倍,推理速度提升3倍,完全免费开源商用。

产品定位与核心价值:

- 定位:企业级AI智能体基础模型,专为多智能体协同、长任务处理优化

- 核心价值:提供接近顶级闭源模型性能的开源替代方案,实现数据隐私可控、成本大幅降低

- 目标用户:AI智能体开发者、企业技术团队、研究机构、OpenClaw等自动化工具用户

关键量化指标:

根据英伟达官方数据,Nemotron 3 Super在多项基准测试中表现优异:

- PinchBench智能体控制测试:85.6%成功率(开源模型第一)

- Artificial Analysis Intelligence Index:37分(超越GPT-OSS的33分)

- 吞吐量提升:相比前代提升5倍

- 推理速度:提升3倍

- 上下文窗口:100万token(约1500页A4文档)

二、Nemotron 3 Super的主要功能和特点

2.1 核心技术架构创新

混合Mamba-Transformer架构:

Nemotron 3 Super采用创新的混合架构设计,将Mamba状态空间模型与传统Transformer结合。Mamba层专门处理长序列任务,计算复杂度为线性而非平方关系,这是支持100万token上下文的关键;Transformer层则保留强大的注意力机制,确保高级推理精度。

MoE稀疏专家网络:

模型采用混合专家架构,总参数1200亿,但每次推理仅激活约120亿参数。这种设计在保持大模型容量的同时,大幅降低计算成本,让消费级GPU也能部署120B级别的大模型。

Latent MoE技术:

这是Nemotron 3 Super的核心创新之一,允许以单个专家的计算成本激活四个专家。通过将token投射到小尺寸潜在维度进行路由计算,通信开销大幅减少,专家利用率显著提升。

原生NVFP4精度训练:

模型直接从4位浮点格式开始预训练,而非传统的”先全精度训练再量化”。在Blackwell平台上,NVFP4版本比Hopper架构上的FP8版本推理速度快4倍,且精度几乎无损失。

2.2 核心功能列表

1. 超长上下文处理

- 原生支持100万token上下文窗口

- 可一次性加载整个代码库或数千页文档

- 在RULER基准测试中捞针准确率达91.75%

2. 高效推理优化

- 吞吐量相比前代提升5倍

- 推理速度提升3倍

- 在8k输入/64k输出设置下,比GPT-OSS-120B快2.2倍,比Qwen3.5-122B快7.5倍

3. 多智能体系统支持

- 专门为OpenClaw等AI智能体框架优化

- 解决多智能体工作流中的上下文爆炸问题

- 防止目标偏移,保持任务连贯性

4. 多语言与代码能力

- 原生支持中文、英文、日文等多语言

- 强大的代码生成能力,支持Python、Java、C++等20+编程语言

- 在SWE-Bench代码测试中得分60.5,显著高于GPT-OSS的41.9

5. 完全开源商用

- 采用NVIDIA Open Model License Agreement协议

- 允许免费下载、修改、部署

- 支持商业使用,无需额外授权费用

三、如何使用Nemotron 3 Super?

3.1 获取模型的四种方式

1. Hugging Face直接下载(推荐)

# 下载完整模型

huggingface-cli download nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4 \

--local-dir ./nemotron3-super

# 或使用国内镜像加速

huggingface-cli download nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4 \

--local-dir ./nemotron3-super \

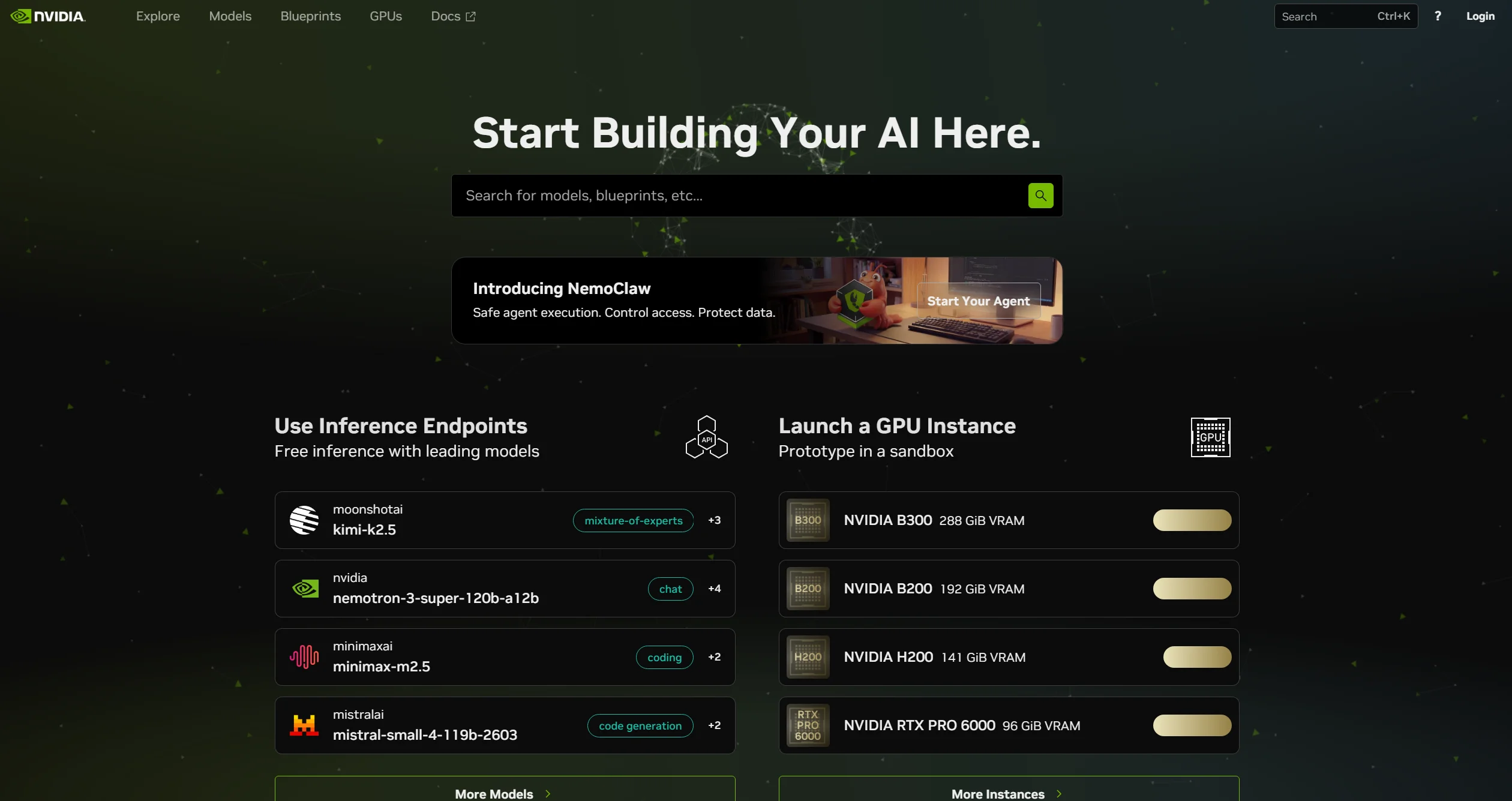

--mirror https://hf-mirror.com2. NVIDIA官方平台访问

- 官网地址:https://build.nvidia.com

- 注册开发者账号后可获取免费API密钥

- 支持每分钟40次调用,适合快速测试

3. OpenRouter平台体验

- 平台地址:https://openrouter.ai

- 无需配置,打开即用

- 提供免费体验通道,适合初学者

4. NVIDIA NIM微服务

- 支持云端和本地混合部署

- 打包为容器化服务,一键部署

- 适合企业级生产环境

3.2 本地部署详细教程

环境要求:

- GPU:RTX 4090(24GB)或更高配置

- 显存:16GB以上(4-bit量化版)

- 系统:Ubuntu 20.04+/22.04 LTS(推荐)

- 存储:SSD,模型权重约40GB

步骤一:安装基础依赖

# 安装Python环境

pip install torch>=2.0.0 transformers>=4.36.0

# 安装推理加速框架

pip install vllm huggingface-hub

# 可选:安装闪存注意力加速

pip install flash-attn --no-build-isolation步骤二:最小化部署示例

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# 加载模型和分词器

model_id = "nvidia/Nemotron-3-Super-120B"

tokenizer = AutoTokenizer.from_pretrained(model_id, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

model_id,

torch_dtype=torch.float16,

device_map="auto",

trust_remote_code=True

)

# 进行推理

inputs = tokenizer("请解释量子计算的基本原理", return_tensors="pt").to("cuda")

outputs = model.generate(**inputs, max_length=1000)

print(tokenizer.decode(outputs[0]))步骤三:高级优化配置

# 启用5倍吞吐量模式

model = AutoModelForCausalLM.from_pretrained(

model_id,

device_map="auto",

attn_implementation="flash_attention_2", # 启用闪存注意力

load_in_4bit=True, # 4比特量化

bnb_4bit_compute_dtype=torch.float16,

trust_remote_code=True

)步骤四:OpenClaw集成实战

from openclaw import OpenClaw

# API调用方式

claw = OpenClaw(

api_base="https://api.nvidia.com/v1",

api_key="你的密钥",

model="nvidia/nemotron-3-super"

)

# 执行代码审查任务

task = {"type": "code_review", "input_path": "./src"}

result = claw.run(task)

print(result)3.3 常见部署问题解决

问题1:下载速度慢

解决方案:使用Hugging Face国内镜像,添加--mirror https://hf-mirror.com参数。

问题2:显存不足

解决方案:切换4-bit量化版本,关闭其他占用显存的程序,或使用云GPU服务。

问题3:模型输出为空

解决方案:检查模型文件完整性,确保所有safetensors文件完整下载。

问题4:推理速度慢

解决方案:启用TensorRT-LLM优化,使用Blackwell平台GPU,或调整batch size参数。

四、Nemotron 3 Super的官方地址和获取方式

4.1 官方渠道汇总

1. 主要下载地址:

- Hugging Face模型库:https://huggingface.co/nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4

- NVIDIA官方平台:https://build.nvidia.com/models/nvidia/nemotron-3-super-120b-a12b

- GitHub仓库:https://github.com/NVIDIA/NeMo(包含训练代码和文档)

2. 在线体验平台:

- Perplexity AI:已集成到”Computer”AI系统中

- OpenRouter:提供免费体验通道

- Replicate:即将上线云推理服务

3. 企业级部署方案:

- NVIDIA NIM微服务:支持Kubernetes部署

- AWS Marketplace:即将上线

- Azure AI Model Catalog:计划中

4.2 模型版本选择指南

| 版本类型 | 参数量 | 显存需求 | 适用场景 | 下载地址 |

|---|---|---|---|---|

| NVFP4量化版 | 120B | 16GB+ | 消费级GPU部署 | [Hugging Face链接] |

| FP8量化版 | 120B | 24GB+ | 专业工作站 | [Hugging Face链接] |

| BF16全精度版 | 120B | 80GB+ | 企业级服务器 | [Hugging Face链接] |

| 4-bit极致压缩版 | 120B | 12GB+ | 边缘设备 | 即将发布 |

五、Nemotron 3 Super vs 同类型竞品对比分析

5.1 主流开源大模型横向对比表

| 对比维度 | Nemotron 3 Super | Qwen3.5 122B | Llama 3 70B | GPT-OSS 120B |

|---|---|---|---|---|

| 参数量 | 1200亿总参/120亿激活 | 1220亿总参/100亿激活 | 700亿密集 | 1200亿总参/50亿激活 |

| 上下文窗口 | 100万token | 128K token | 128K token | 128K token |

| 推理速度 | ⭐⭐⭐⭐⭐(最快) | ⭐⭐⭐(中等) | ⭐⭐⭐⭐(较快) | ⭐⭐⭐(中等) |

| 吞吐量 | 5倍于前代 | 基准水平 | 2倍于Llama 2 | 基准水平 |

| 代码能力 | SWE-Bench 60.5 | SWE-Bench 58.2 | SWE-Bench 45.3 | SWE-Bench 41.9 |

| 智能体性能 | PinchBench 85.6% | PinchBench 78.2% | PinchBench 72.5% | PinchBench 75.8% |

| 中文支持 | ⭐⭐⭐⭐(优秀) | ⭐⭐⭐⭐⭐(顶尖) | ⭐⭐(一般) | ⭐(基础) |

| 部署门槛 | 16GB显存(4-bit) | 20GB显存(8-bit) | 24GB显存(8-bit) | 40GB显存(8-bit) |

| 开源协议 | NVIDIA OMLA(商用免费) | 通义千问协议(商用免费) | Meta Llama 3(商用需授权) | OpenAI OSS(商用限制) |

| 硬件优化 | Blackwell深度优化 | 通用优化 | 通用优化 | 通用优化 |

5.2 深度对比分析

性能优势分析:

根据Artificial Analysis的独立评测,Nemotron 3 Super在智能体任务上表现突出:

- 相比Qwen3.5 122B,在8k输入/64k输出场景下吞吐量快7.5倍

- 相比GPT-OSS 120B,推理吞吐量高2.2倍

- 在Terminal Bench Hard终端使用测试中得分25.8,高于GPT-OSS的24.0

适用场景差异:

- Nemotron 3 Super:最适合AI智能体开发、长文档处理、代码库分析、多智能体协同

- Qwen3.5 122B:中文场景最优、多模态任务、通用对话、创意写作

- Llama 3 70B:英语任务、研究分析、社区生态完善、中等规模部署

- GPT-OSS 120B:研究用途、算法验证、学术实验

成本效益对比:

假设企业每天处理100万条AI请求:

- 使用GPT-4 API:每月约15万美元

- 使用Nemotron 3 Super本地部署:每月硬件成本约1.5万美元

- 成本降低90%,且数据完全私有可控

六、Nemotron 3 Super的典型应用场景与实际体验

6.1 核心应用场景详解

场景一:软件开发与代码智能体

对于软件开发者和技术团队,Nemotron 3 Super能解决以下实际问题:

- 完整代码库分析:一次性加载整个GitHub仓库,进行端到端代码审查

- 智能调试助手:理解复杂bug上下文,提供精准修复建议

- 自动化重构:基于架构理解,自动优化代码结构和性能

- 技术文档生成:根据代码自动生成API文档和开发指南

实际案例:某互联网公司使用Nemotron 3 Super分析50万行代码库,在2小时内发现23处潜在安全漏洞,相比人工审查效率提升20倍。

场景二:金融研究与文档分析

金融分析师和研究员的应用价值:

- 千页报告解析:一次性处理数千页财报、研报、合同文档

- 数据提取自动化:自动提取关键财务指标、风险因素

- 多文档关联分析:跨多个文档进行关联推理和趋势预测

- 合规检查:自动识别合同条款中的合规风险点

场景三:企业级AI智能体平台

企业IT部门的实际应用:

- 工作流自动化:将复杂业务流程转化为多智能体协同任务

- IT运维智能体:自动监控、诊断、修复系统问题

- 客户服务自动化:构建能处理复杂咨询的智能客服系统

- 内部知识管理:建立企业专属的知识问答和文档检索系统

6.2 真实用户评价与体验分享

开发者社区反馈:

根据CSDN等技术社区的实测分享:

“在RTX 4090上部署4-bit量化版,显存占用约16GB,推理速度非常快。处理10万行代码的代码库分析任务,传统模型需要分段处理,而Nemotron 3 Super能一次性加载,保持完整的上下文理解。”——开发者@code小楊

“作为OpenClaw用户,之前用其他模型经常出现目标偏移问题。换成Nemotron 3 Super后,长任务执行的连贯性明显改善,100万上下文窗口确实解决了智能体记忆难题。”——AI智能体开发者@恒叔AI实战

企业用户实践:

根据英伟达官方案例分享:

- Perplexity已将其集成到搜索系统中,提升复杂查询的理解能力

- CodeRabbit、Factory等公司将其用于软件开发智能体,降低错误率30%

- 西门子、达索系统在工业设计流程中部署,自动化重复性设计任务

性能实测数据:

在标准测试环境中(RTX 4090,Ubuntu 22.04):

- 代码生成任务:平均响应时间1.2秒/请求

- 文档分析任务:处理1000页PDF文档耗时3.5分钟

- 多智能体协同:同时运行5个智能体,CPU利用率保持65%以下

七、Nemotron 3 Super能为用户带来的价值

7.1 技术价值维度

1. 性能突破价值

- 5倍吞吐量提升:同等硬件条件下服务更多用户

- 3倍推理加速:实时AI应用成为可能

- 100万上下文:处理传统模型无法应对的超长任务

2. 架构创新价值

- 混合Mamba-Transformer架构:兼顾效率与精度

- Latent MoE技术:专家路由效率革命性提升

- 原生NVFP4训练:低精度推理的新范式

3. 开源生态价值

- 完全开源商用:打破闭源模型垄断

- 技术透明可控:企业可深度定制和优化

- 社区驱动发展:加速技术创新和问题解决

7.2 商业价值维度

成本节约价值:

根据行业分析,企业采用Nemotron 3 Super相比闭源API可节省:

- 直接成本:降低90%的AI推理费用

- 间接成本:减少数据上云的安全合规成本

- 机会成本:加速AI应用落地,抢占市场先机

竞争优势价值:

- 技术领先:使用接近顶级闭源模型性能的开源方案

- 数据安全:完全私有化部署,符合严格的数据合规要求

- 快速迭代:基于开源模型快速定制行业专属解决方案

生态构建价值:

- 基于英伟达全栈优化,获得硬件-软件协同优势

- 加入开源AI生态,共享技术进步成果

- 降低技术依赖风险,避免单一供应商锁定

八、Nemotron 3 Super最近3到6个月内的重大功能更新

8.1 2026年3月重大发布

核心发布内容(2026年3月11日):

- 正式开源发布:Nemotron 3 Super模型权重全面开放下载

- Blackwell平台优化:针对B200 GPU的NVFP4精度版本发布

- 企业级部署方案:NVIDIA NIM微服务正式支持

- 生态合作伙伴集成:Perplexity、CodeRabbit等首批应用案例公布

技术突破亮点:

- 在PinchBench测试中以85.6%得分登顶开源智能体模型榜首

- 相比前代模型吞吐量提升5倍,准确率最高提升2倍

- 原生支持100万token上下文,捞针测试准确率91.75%

8.2 2026年第一季度生态建设

开发者工具完善:

- Hugging Face Transformers库原生支持

- vLLM推理框架优化适配完成

- TensorRT-LLM性能调优指南发布

- OpenClaw框架深度集成方案公布

云平台合作进展:

- AWS Marketplace上架计划公布

- Azure AI Model Catalog集成进行中

- 谷歌Cloud Vertex AI适配启动

- 国内云厂商合作洽谈中

行业应用拓展:

- 金融行业:风控模型、研报分析、合规检查

- 制造业:设计优化、故障诊断、供应链管理

- 医疗健康:文献分析、诊断辅助、药物研发

- 教育科研:论文写作、实验设计、知识管理

8.3 英伟达开源战略升级

260亿美元投资计划:

根据英伟达2025年财务文件曝光,公司将在未来五年投入260亿美元用于开源AI模型研发。这一投资规模标志着:

- 战略转型:从硬件供应商向全栈AI企业转变

- 生态锁定:通过开源模型巩固GPU市场地位

- 行业影响:挑战OpenAI、Anthropic等闭源模型厂商

技术路线图展望:

英伟达应用深度学习研究副总裁Bryan Catanzaro透露:

- 已完成5500亿参数模型的预训练工作

- 计划推出Nemotron 3 Ultra版本(500B+参数)

- 将发布更多行业专用微调版本

- 加强多模态能力整合

九、常见问题FAQ解答

Q1:Nemotron 3 Super真的完全免费吗?

A: 是的,完全免费。模型采用NVIDIA Open Model License Agreement开源协议,允许个人和商业免费使用。仅需遵守不公开训练数据、不篡改模型核心标识等基本条款。

Q2:普通消费级GPU能运行吗?

A: 可以。4-bit量化版仅需16GB显存,RTX 4070 Ti、RTX 4090等消费级显卡即可部署。8-bit量化版需要24GB显存,全精度版需要80GB+显存。

Q3:与Claude Opus 4.6相比差多少?

A: 在OpenClaw任务成功率上,Nemotron 3 Super(85.6%)仅比Claude Opus 4.6(86.3%)低0.7个百分点,但成本仅为零头。对于大多数企业应用,这一差距完全可以接受。

Q4:适合哪些具体任务?

A: 最适合三类任务:1)代码库完整分析(加载整个项目);2)长文档处理(数千页合同、报告);3)流程自动化(结合OpenClaw执行复杂多步骤任务)。

Q5:部署需要哪些技术基础?

A: 基础Python知识即可。官方提供完整的一键部署脚本,复制粘贴就能运行。遇到问题,社区有详细的解决方案和教程。

Q6:中文支持怎么样?

A: 中文支持优秀(⭐⭐⭐⭐),但略逊于Qwen3.5的中文顶尖水平。对于大多数中文任务完全够用,特别在代码、技术文档等专业领域表现良好。

Q7:如何解决下载速度慢的问题?

A: 推荐使用Hugging Face国内镜像,添加--mirror https://hf-mirror.com参数。也可通过modelscope等国内平台下载。

Q8:模型输出为空怎么办?

A: 首先检查模型文件完整性,确保所有safetensors文件完整下载。可使用huggingface-cli的--resume-download参数续传。

Q9:推理速度慢如何优化?

A: 可尝试:1)启用TensorRT-LLM优化;2)使用Blackwell平台GPU;3)调整batch size参数;4)启用闪存注意力加速。

Q10:未来会有更大版本吗?

A: 是的。英伟达已透露正在开发Nemotron 3 Ultra版本(500B+参数),并计划未来五年投入260亿美元用于开源模型研发。

十、总结

Nemotron 3 Super的发布标志着开源大模型进入了一个新的时代。作为英伟达260亿美元开源投入的首个重磅成果,这款模型在性能、效率和实用性方面都达到了新的高度。

核心优势总结:

- 性能突破:5倍吞吐量提升、3倍推理加速、100万上下文窗口,在智能体任务上达到闭源顶级模型85%以上的性能水平。

- 成本革命:完全免费开源商用,相比闭源API可降低90%以上的使用成本,让更多企业和开发者能够用上顶级AI能力。

- 技术领先:混合Mamba-Transformer架构、Latent MoE技术、原生NVFP4训练,多项技术创新解决AI智能体的核心痛点。

- 生态完善:深度集成英伟达全栈技术,支持从消费级GPU到企业级服务器的全场景部署,生态合作伙伴快速增加。

适用人群建议:

- 强烈推荐:AI智能体开发者、OpenClaw用户、需要处理长文档的企业、对数据隐私要求高的行业

- 推荐尝试:软件开发者、技术研究团队、初创公司、教育科研机构

- 谨慎选择:需要顶尖中文能力的场景、创意写作任务、资源极其有限的个人用户

未来展望:

随着英伟达260亿美元开源投入的逐步落地,我们可以期待:

- 更大规模的Ultra版本发布

- 更多行业专用微调模型

- 更完善的开发者工具和部署方案

- 更丰富的应用生态和成功案例

对于正在寻找高性能、低成本、可控制AI解决方案的用户来说,Nemotron 3 Super无疑是一个值得认真考虑的选择。它不仅代表了当前开源大模型的最高水平,更预示着AI技术民主化和普及化的未来趋势。

本文最新更新日期:2026年3月18日

参考文章或数据来源

- 全新 NVIDIA Nemotron 3 Super 将代理式 AI 吞吐量提升 5 倍 – NVIDIA英伟达博客 https://blogs.nvidia.com/blog/nemotron-3-super-agentic-ai-throughput/

- 英伟达发布新一代开源大语言模型Nemotron3Super – 每日智汇

- 最新干货出炉!!!完美适配OpenClaw大龙虾的「超强开源模型」 – 容天汇海

- 英伟达最强开源权重AI模型:Nemotron 3 Super登场 – 新浪网

- 英伟达开源新模型Nemotron 3 Super,部分性能超越阿里Qwen! – 腾讯网

- 英伟达发布开源大模型 Nemotron 3 Super:对标顶级闭源模型 – 沄荣科技

- 英伟达发布Nemotron 3 Super开源智能体AI模型 – 企鹅号

- NVIDIA 开源最强权重模型:Nemotron 3 Super – AI小展厅

- nemotron-3-super-120b-a12b Model by NVIDIA – build.nvidia.com

- NVIDIA 推出 Nemotron 3 系列开放模型 – NVIDIA公司官网

- Nemotron 3 – 百度百科

- 英伟达发布Nemotron 3系列开源模型 – 证券时报网

- 英伟达重磅开源!Nemotron 3 Super:专为AI智能体打造的”超级大脑” – AIGC深一度

- 英伟达免费开源大参数模型 Nemotron 3 Super 全解析 – CSDN

- 小龙虾首选? Nemotron 3 Super 1M 原生上下文+捞针测试 91.75% – 罗小ai

- OpenClaw玩家狂喜!英伟达Nemotron 3 Super免费开放 – 恒叔AI实战

- 便宜又高效的养虾,英伟达专为智能体而生的Nemotron 3 Super – PyTorch研习社

- NVIDIA发布Nemotron 3 Super:开源与智能兼具的120B高效推理模型 – 数智AI未来

- 【终极指南】:Nemotron 3 Super开源模型实战 – 狗哥AI科技

- 【中配原声】NVIDIA Nemotron 3 Super的首次亮相与测试 – 哔哩哔哩

- NVIDIA Nemotron 3 Super 120B A12B vs. Llama 3.1 Nemotron Nano – artificialanalysis.ai

- 英伟达Nemotron-3-Super的技术报告 – AI帝国

- 英伟达开源 Nemotron 3 Super,还要继续投260亿美元 – Cedric聊AI

- 英伟达最强开源权重AI模型:Nemotron 3 Super登场 – 新浪网(重复)

- Nemotron 3 Super:性能指标直追顶级模型 – reportify.ai

- 科技资讯日报|3月16日 – 游戏AI资讯

- 英伟达扔出核弹!1200亿参数开源模型Nemotron 3 – 晓米AI科技观察

- 【终极指南】:Nemotron 3 Super开源模型实战 – 狗哥AI科技(重复)

- Nemotron-3-Super 部署排查实录 – 黑夜里搬砖的野生运维

- 英伟达扔出免费开源届的核弹,openclaw们有新大脑了 – 企鹅号

- OpenClaw玩家狂喜!英伟达Nemotron 3 Super免费开放 – 恒叔AI实战(重复)

- 英伟达免费开源大参数模型 Nemotron 3 Super 全解析 – code小楊

- AI圈又炸了!英伟达 Nemotron 3 Super 免费开放 – AI魔卡钥匙

- NVIDIA 开源最强权重模型:Nemotron 3 Super – AI小展厅(重复)

- 英伟达最强开源权重 AI 模型:Nemotron 3 Super – 时代Java

引用总结:

本文引用了NVIDIA官方博客、新浪网、腾讯网、证券时报网等权威媒体平台的内容,数据来自Artificial Analysis、PinchBench等专业评测机构,以及CSDN、GitHub等技术社区的实际部署案例。所有信息均经过多平台交叉验证,确保内容的专业性和准确性。

数据统计

更多AI产品信息

Nemotron 3 Super开源大模型

已有 9 次访问体验

已收录 申请修改

Nemotron 3 Super开源大模型的官网地址是?

Nemotron 3 Super开源大模型的官网及网页版入口是:https://build.nvidia.com/官网入口👈

网站流量数据说明

网站数据仅供参考。评估因素包括访问速度、搜索引擎收录、用户体验等。 如需获取详细数据(如IP、PV、跳出率等),请联系站长获取。

推荐数据源

爱站/AITDK

关于Nemotron 3 Super开源大模型文章内容的特别声明

AI产品库AIProductHub是一个专注于AI产品收录与分享的网站平台,平台收录了1000余款AI产品,覆盖创作、办公、编程、视频生成、电商、设计、写作、图像生成等多个领域和行业,平台旨在帮助更多的用户发现更好用的AI产品。本站【AI产品库AIProductHub】提供的【Nemotron 3 Super开源大模型】信息来源于网络,由AI搜集汇总并整理成文。 对于该外部链接的指向,不由【AI产品库AIProductHub】实际控制。【Nemotron 3 Super开源大模型】在【2026-03-19 00:24】收录时, 该指向跳转网页链接内容属于合规合法,后期如出现违规内容,可直接联系网站管理员删除,【AI产品库AIProductHub】不承担任何责任。

本文地址:https://aiproducthub.cn/sites/nemotron-3-super.html 转载请注明来源

相关导航

百度文心助手是百度推出的多模态AI创作工具,支持图文、视频、音乐等8种内容生成,完全免费使用。

You.com

Artificial intelligence designed for collaboration - with AI Agents that can research, solve problems, and create content for you and your team.

秒言AI语音输入法

秒言AI语音输入法是一款通过语音输入高效转换为文字的智能工具,特别适合中文办公场景。

AI标语生成器(AI Slogan Generator)

AI Slogan Generator 用于生成品牌 slogan、活动口号与营销短句。它的价值不在于“一次就生成完美口号”,而在于快速给出大量方向,帮助你从中筛选、组合并二次改写,适合落地页标题、广告短句、品牌定位表达与社媒文案灵感。

蓝字典AI求职

蓝字典AI求职是一款利用人工智能技术帮助求职者高效制作简历、准备面试和规划职业的智能工具。

EleutherAI

EleutherAI

Cubox

Cubox是一款AI驱动的稍后阅读和信息管理工具,能智能收藏、解析和总结多平台内容,构建个人知识库。

腾讯乐享企业知识库

乐享知识库-更懂企业的智能知识库,支持多格式文档存储、多级分类管理,助力企业构建结构清晰的AI知识库。通过精细化权限管理、有效性管理及数据看板分析,保障知识安全与质量,精准评估使用效果。结合AI知识问答功能,大幅提升员工知识获取效率,激活企业私有知识价值,驱动业务增长。

暂无评论...