Meta SAM 3D是什么?如何实现单图生成高质量3D模型?

1 Meta SAM 3D是什么?

Meta SAM 3D是Meta公司于2025年11月20日正式发布的革命性AI模型,代表了Segment Anything系列从2D分割向3D理解的重要进化。这一创新系统能够从单张二维图像中推断出三维几何结构,实现了从2D到3D的质的飞跃。 SAM 3D主要包含两个独立且高度专业化的模型:SAM 3D Objects专门处理物体与场景的三维重建,能够从单张图像预测物体和场景的三维结构;而SAM 3D Body则专注于人体姿态、骨骼以及可动画网格的单图三维恢复。

这两个模型采用统一框架设计,分别针对不同结构进行优化,同时兼容SAM生态系统中的标注、检测和分割能力。 与传统3D重建方法相比,SAM 3D的突破性在于它不依赖多视角输入或复杂的光场设置,仅通过单张图像就能实现多视角一致的深度估计、完整的网格重建(包含不可见部分的合理补全)、材质与表面外观估计等复杂任务。这使得3D重建技术从专业工作室走向普通用户成为可能,大大降低了3D内容创作的技术门槛。

2 SAM 3D的主要功能和特点

2.1 核心技术功能

2.1.1 SAM 3D Objects:物体与场景重建

SAM 3D Objects具备从单张自然图像中实现稳健3D重建的能力,包括多视角一致的深度估计、完整的网格重建、材质与表面外观估计,以及在复杂遮挡情况下的形状推断。该模型在技术上采用多头预测结构,可同时回归深度、表面法线、遮罩、网格等多模态信息,实现了面向真实场景与合成场景的强泛化能力。

与过去基于NeRF或多视角SfM的方法不同,SAM 3D Objects通过大规模训练与多任务协同学习实现单图完整重建,不再依赖多视角输入。这意味着即使面对小物体、间接视角和遮挡现象,模型也能利用识别能力与上下文信息来弥补纯视觉像素的缺失,完成高质量重建。

2.1.2 SAM 3D Body:人体三维重建

SAM 3D Body专注于从单张图像中恢复人体三维网格,包括SMPL/SMPL-X风格的可动画人体网格重建、姿态估计、身体形状预测,以及手部、脚部和肢体关键点的高精度恢复。该模型采用端到端训练,不需要额外的姿态检测器,具有较强的鲁棒性,可处理非标准姿势、遮挡与部分出画等复杂情况。

模型支持提示输入,用户可以通过分割掩码、二维关键点等方式引导和控制模型的预测,让三维重建更具交互性和可控性。SAM 3D Body在架构上采用Transformer编码器-解码器设计,图像编码器能捕捉身体各部位的高分辨率细节,而网格解码器则支持基于提示的三维网格预测。

2.2 技术突破与创新

2.2.1 革命性的数据引擎

SAM 3D的核心突破在于解决了3D训练数据稀缺的长期难题。Meta构建了一个创新的数据标注引擎,采用”模型在环”策略,让标注人员对模型生成的多个3D候选结果进行评分,而最困难的样例则交给专业3D艺术家处理。通过这种方法,团队标注了近100万张图像,生成了约314万个3D网格,创造了前所未有的训练规模。

2.2.2 多阶段训练流程

SAM 3D借鉴了大型语言模型的训练范式,将合成数据学习重新定义为3D的”预训练”阶段,然后加入针对真实图像的后训练阶段(对齐阶段),以弥补模拟环境与真实环境之间的鸿沟。这种多阶段训练流程使模型能有效处理真实世界图像的复杂性,实现了从合成数据到自然图像的顺利过渡。

2.2.3 高效推理性能

在实际性能方面,SAM 3D表现出色。结合扩散捷径和其他工程优化,它能在几秒钟内完成全纹理3D重建,使得近乎实时的3D应用成为可能。在人类偏好测试中,SAM 3D Objects相对于其他领先模型的胜率至少达到5:1,体现了其卓越的输出质量。

3 如何使用SAM 3D?详细操作指南

3.1 在线体验平台

对于大多数用户而言,最简单的使用方式是通过Meta官方提供的Segment Anything Playground在线平台。该平台无需安装任何软件,只需通过浏览器即可体验SAM 3D的核心功能。 具体操作步骤如下:

- 访问Segment Anything Playground官网:https://www.aidemos.meta.com/segment-anything/

- 选择想要尝试的方向(3D场景重建或3D人体重建)

- 直接上传一张包含目标物体或人物的图像

- 在图像上标注几个关键点,为要生成的区域增加Mask

- 点击生成按钮,等待系统处理

- 片刻之后3D模型重建完成,可通过拖动直接观看3D对象

- 可继续添加材质、环境、特效、背景图等素材,增强视觉效果

3.2 本地部署与开发集成

对于开发者和研究人员,Meta已经开源了SAM 3D的模型权重、推理代码和相关工具。本地部署允许更高级的自定义和集成可能性。 SAM 3D Objects本地部署流程:

- 访问GitHub仓库:https://github.com/facebookresearch/sam-3d-objects

- 按照README说明安装依赖环境

- 下载预训练模型权重

- 运行推理代码处理自定义图像

SAM 3D Body集成示例: 开发者可将SAM 3D Body集成到现有的人体分析 pipeline中,实现自动化的3D人体网格重建。模型支持多种输入提示,如2D关键点、边界框或分割掩码,为用户提供了灵活的控制方式。

3.3 实用技巧与最佳实践

为了获得最佳的重建效果,建议用户注意以下几点:

- 图像质量:输入图像应具有足够的分辨率和清晰度,避免过度模糊或噪点

- 视角选择:尽量使用正面或45度角视角的图像,避免极端角度或严重遮挡

- 背景简洁:相对简洁的背景有助于模型更准确地分离主体与背景

- 光照条件:均匀的光照有助于模型理解物体表面的纹理和形状细节

对于复杂场景,可以尝试多次推理与结果融合的策略,即通过略微不同的提示点或边界框获取多个重建结果,然后选择最优的一个。

4 SAM 3D的官方地址与获取方式

4.1 官方资源汇总

Meta为SAM 3D提供了全面的官方资源,方便不同需求的用户获取和使用:

- 项目主页:https://ai.meta.com/sam3d/

- 在线体验平台:https://www.aidemos.meta.com/segment-anything/

- SAM 3D Objects代码仓库:https://github.com/facebookresearch/sam-3d-objects

- SAM 3D Body代码仓库:https://github.com/facebookresearch/sam-3d-body

- 研究论文:

4.2 授权与费用信息

根据目前公开信息,SAM 3D模型采用开源许可证,允许学术研究和商业使用。个人用户和小型开发者可以免费使用在线平台和开源代码,而大型企业用户可能需要关注Meta的官方商业使用条款。 Meta表示,SAM 3D的相关技术将整合到其产品生态中,如Instagram视频创作应用Edits和Meta AI应用,但这些集成产品的具体收费模式可能因产品而异。

5 SAM 3D vs 竞品对比分析

5.1 与传统3D重建方法对比

与传统3D重建技术相比,SAM 3D具有明显优势。传统方法通常需要多视角图像或专业设备(如深度相机、激光扫描仪),而SAM 3D仅需单张图像即可实现可比较的重建效果。下表展示了SAM 3D与传统方法的关键差异:

| 特性对比 | SAM 3D | 传统多视角几何 | 基于NeRF的方法 |

|---|---|---|---|

| 输入要求 | 单张图像 | 多视角图像(10+) | 多视角图像(50+) |

| 硬件需求 | 普通GPU/在线推理 | 专业采集设备 | 高性能GPU集群 |

| 处理时间 | 几秒钟 | 几小时到数天 | 数十分钟到数小时 |

| 遮挡处理 | 通过上下文推理补全 | 依赖视角间信息 | 部分补全能力 |

| 纹理质量 | 高保真材质估计 | 依赖原始图像 | 高分辨率输出 |

5.2 与同类AI模型的对比

在AI驱动的3D重建领域,SAM 3D也表现出显著优势。与Wonder3D等同期模型相比,SAM 3D在重建质量和泛化能力上更胜一筹。 与Wonder3D的对比分析: Wonder3D是另一款知名的单图转3D模型,但其严重依赖前景提取质量。研究表明,通过集成SAM(2D版本)提升分割质量,Wonder3D的边界IoU可提升42.3%,3D模型网格质量提升35.7%。

这反衬出SAM 3D在基础分割能力上的优势,因为SAM 3D直接内置了先进的分割和理解能力。 在人体重建方面,SAM 3D Body采用的Momentum Human Rig表示法相比传统的Skinned Multi-Person Linear模型具有明显优势,将骨骼姿态与身体形状参数显式解耦,避免了传统模型中骨肉粘连导致的调整失真问题。

5.3 性能基准测试结果

根据Meta发布的官方测试数据,SAM 3D在多个关键指标上领先竞品:

- 在人类偏好测试中,SAM 3D Objects以至少5:1的胜率领先其他领先模型

- SAM 3D Body在多个3D人体基准测试中的准确性和稳健性均超越以往模型

- 在处理速度方面,SAM 3D可在几秒钟内完成全纹理3D重建,适合近实时应用

6 SAM 3D的典型应用场景

6.1 数字内容创作与娱乐产业

SAM 3D为游戏开发、影视制作和AR/VR内容创作带来了革命性变化。传统3D资产制作需要专业建模师花费数小时甚至数天完成,而SAM 3D可将这一过程缩短到几秒钟。对于独立开发者和小型工作室,这大大降低了制作成本,使高质量3D内容创作更加普及。 在虚拟人制作方面,SAM 3D Body能够从单张照片生成可动画的人体网格,极大简化了数字人创建流程。这对于虚拟偶像、数字分身等应用具有重要价值。

6.2 电子商务与零售

Meta已经开始将SAM 3D技术应用于电子商务场景。Facebook Marketplace新推出的”房间预览”功能,允许用户在购买家居装饰品前将产品在自己的空间中进行可视化。这种基于SAM 3D的增强现实体验,显著提升了购物决策的准确性和用户满意度。

6.3 工业设计与制造

在产品设计领域,SAM 3D能够快速将概念草图或原型照片转化为3D模型,加速设计迭代过程。制造业可以利用该技术进行零部件数字化库存、逆向工程等应用。

6.4 机器人技术与自动驾驶

SAM 3D的实时3D感知能力为机器人环境理解提供了新可能。传统的机器人视觉系统通常依赖深度相机或复杂的传感器融合算法,而SAM 3D仅需单目摄像头即可实现环境3D结构理解,降低了硬件成本和系统复杂度。 在自动驾驶领域,从单帧图像恢复环境结构的能力可以减少对多视角摄像机的依赖,提升系统在特殊场景下的鲁棒性。

7 SAM 3D能为用户带来的价值

7.1 技术层面的价值主张

SAM 3D的核心价值在于它将专业级的3D重建能力 democratize(普及化),使普通用户也能轻松创建高质量3D内容。具体而言,它带来以下技术价值:

- 效率提升:将3D内容创作从小时级压缩到秒级,效率提升数十倍甚至上百倍

- 成本降低:减少对专业3D建模师和昂贵采集设备的依赖,大幅降低制作成本

- 质量保证:基于大规模高质量数据训练,输出结果稳定且符合工业标准

- 易用性优化:直观的提示式交互,无需专业培训即可上手使用

7.2 商业与创新价值

从商业视角看,SAM 3D不仅仅是一个技术工具,更是推动多个行业创新的催化剂:

- 为中小企业赋能:使预算有限的小团队也能接触高端3D技术,促进创新平等

- 加速创意实现:缩短从概念到原型的过程,加快产品迭代速度

- 开启新应用场景:使原来因技术或成本限制不可行的应用成为现实

- 促进生态发展:开源策略鼓励开发者社区贡献代码和插件,形成良性生态

8 SAM 3D最新重大更新动态(2025年11月)

2025年11月20日,Meta正式发布了SAM 3D系列模型,这是Segment Anything模型家族在3D领域的重要扩展。此次发布包含以下关键动态:

8.1 模型与技术发布

本次更新同时推出了SAM 3D Objects和SAM 3D Body两个核心模型,以及配套的推理代码、预训练权重和评估基准。同时发布的还有专门为3D重建评估构建的SA-3DAO数据集,这是首个专门用于评估物理世界图像中单幅3D重建能力的数据集。

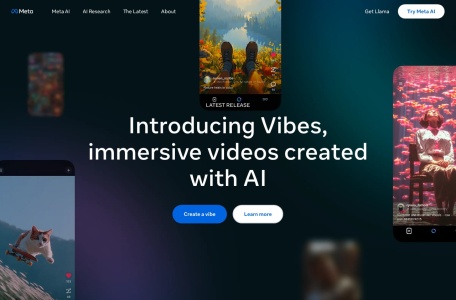

8.2 平台与产品整合

Meta推出了Segment Anything Playground在线平台,让普通用户无需技术背景即可体验SAM 3D和SAM 3的能力。同时,公司已开始将相关技术整合到实际产品中,如Facebook Marketplace的”房间预览”功能,体现了”发布即产品”的务实策略。

8.3 开源生态建设

Meta采用了全面开源策略,不仅发布了模型权重和推理代码,还分享了微调方法,鼓励开发者社区参与改进和适配。这种开放态度有助于加速SAM 3D在各行业的应用和创新。

9 常见问题FAQ解答

9.1 技术能力相关问题

Q1: SAM 3D支持哪些类型的图像作为输入? SAM 3D支持大多数常见格式的自然图像(如JPEG、PNG等),对图像内容没有严格限制。但对于最佳效果,建议使用分辨率较高、主体清晰、光照均匀的图像。

Q2: 模型对计算资源要求高吗?在线版和本地版有何区别? 在线版本通过Meta的云服务提供计算,用户无需担心硬件需求。本地部署版本建议使用至少8GB显存的GPU(如NVIDIA RTX 3070以上)以获得流畅体验。对于SAM 3D Objects,推理单张图像约需几秒钟。

Q3: SAM 3D能否处理透明物体或复杂结构? 当前版本对透明物体和极端复杂结构的处理仍有局限,但在一般复杂度的场景下已表现优异。模型通过上下文理解能力,能够对部分遮挡物体进行合理重建。

9.2 使用与授权问题

Q4: 商业使用是否需要特殊授权? SAM 3D采用开源许可证,允许大多数商业用途。但大规模企业部署建议查阅最新官方许可协议,确认具体条款。

Q5: 如何将SAM 3D集成到自己的应用中? 开发者可通过官方GitHub仓库获取代码和API文档,支持Python等主流语言集成。Meta提供了详细的示例和教程,帮助开发者快速上手。

10 总结

Meta SAM 3D的发布标志着计算机视觉领域从2D理解向3D重建的重要进化。通过创新的数据引擎和训练流程,SAM 3D成功解决了3D重建领域长期存在的数据稀缺和泛化能力不足的难题。 从技术视角看,SAM 3D不仅在使用便利性上实现了突破(单图输入即可输出高质量3D模型),更在重建质量上达到了业界领先水平,在人类偏好测试中以显著优势超越现有方法。

其提示式交互设计既降低了普通用户的使用门槛,又为专业用户提供了精细控制的可能性。 从应用视角看,SAM 3D为数字内容创作、电子商务、工业设计、机器人技术等众多领域带来了新的可能。将专业级3D重建能力 democratize(普及化),有望激发新一轮的创新浪潮。

尽管当前模型在极端复杂场景下仍有改进空间,但SAM 3D无疑为3D内容创作的未来描绘了令人兴奋的图景。随着技术的不断迭代和开发者生态的壮大,我们有理由期待SAM 3D在更多场景中发挥价值,推动整个数字世界向更加立体、沉浸的方向发展。

参考文章或数据来源

- Meta 发布 SAM 3D:从单张图片生成高质量 3D 模型!可直接上手体验!(2025年11月20日)

- AI视觉GPT时刻!Meta新模型一键“分割世界”,网友直呼太疯狂了(2025年11月20日)

- 分割一切并不够,还要3D重建一切,SAM 3D来了(2025年11月20日)

- 发布即产品!SAM 3D横空出世:Meta再次颠覆3D视觉,单图即可实现高精度三维重建(2025年11月20日)

- Meta「分割一切」进入3D时代!图像分割结果直出3D,有遮挡也能复原(2025年11月20日)

- Meta“分割一切”模型强势升级!处理含上百物体一张图仅需30毫秒(2025年11月20日)

- Meta「分割一切」进入3D时代!图像分割结果直出3D,有遮挡也能复原(2025年11月20日)

- 使用SAM提升Wonder3D分割质量:前景提取最佳实践(2025年9月21日)

数据统计

更多AI产品信息

Meta SAM 3D

已有 3,334 次访问体验

已收录

申请修改

Meta SAM 3D的官网地址是?

Meta SAM 3D的官网及网页版入口是:https://ai.meta.com/sam3d/?utm_source=AIProductHub 官网入口👈

网站流量数据说明

网站数据仅供参考。评估因素包括访问速度、搜索引擎收录、用户体验等。 如需获取详细数据(如IP、PV、跳出率等),请联系站长获取。

推荐数据源

爱站/AITDK

关于Meta SAM 3D文章内容的特别声明

AI产品库AIProductHub是一个专注于AI产品收录与分享的网站平台,平台收录了1000余款AI产品,覆盖创作、办公、编程、视频生成、电商、设计、写作、图像生成等多个领域和行业,平台旨在帮助更多的用户发现更好用的AI产品。本站【AI产品库官网 – AIProductHub】提供的【Meta SAM 3D】信息来源于网络,由AI搜集汇总并整理成文。 对于该外部链接的指向,不由【AI产品库官网 – AIProductHub】实际控制。【Meta SAM 3D】在【2025-11-22 00:38】收录时, 该指向跳转网页链接内容属于合规合法,后期如出现违规内容,可直接联系网站管理员删除,【AI产品库官网 – AIProductHub】不承担任何责任。

本文地址:https://aiproducthub.cn/sites/meta-sam-3d.html 转载请注明来源

相关导航

Perfect your English with a free AI writer that can paraphrase, rewrite, correct your grammar and more.

飞象老师

飞象老师是专为教师设计的AI工具,一句话即可生成交互教学动画与游戏课件,免费面向全国教师开放。

通义千问

通义是一个通情、达义的国产AI模型,可以帮你解答问题、文档阅读、联网搜索并写作总结,最多支持1000万字的文档速读。通义_你的全能AI助手

“飞鱼-1.0”海-气双向耦合大模型

飞鱼-1.0是全球首个面向南海的海-气双向耦合智能大模型,实现3秒完成3天海洋预报,打破国外数据依赖。

声网

声网提供全球领先的实时音视频云服务与对话式AI引擎,让开发者快速集成低延迟、高稳定的语音视频交互能力。

咔片PPT

咔片(cappt)AIPPT在线智能制作,工作总结/教学课件/商业提案3分钟搞定,10万+场景模板一键替换,AI自动排版+多格式导出,支持在线编辑,一键生成PPT,咔片ppt制作网站基础功能永久免费使用!

copysmith ai

Your AI Tech Stack for Effi...

Vivago AI(智小象)

Vivago AI(智小象)是一款集图片生成、视频制作、AI播客等功能于一体的全能AI创作平台,主打零技术门槛和高效创作。

暂无评论...